В края на май т.г. в 28-те държави членки на Европейския съюз се проведоха деветите избори за Европейски парламент. С рекордна за последните 20 години избирателна активност (почти 51%) бе определен съставът на единствената пряко избираема от гражданите институция на ЕС. Като едно от големите предизвикателства бе посочена

опасността от манипулиране на информацията и респективно на обществения дебат, на чиято база имащите право на глас вземат решение кого да подкрепят.

Достатъчно е да се спомене докладът на Freedom House от 2017 г., според който над 30 държави си служат с различни техники за влияние чрез онлайн съдържание, в т.ч. дезинформация; или да се припомнят мащабите на случая Facebook/Cambridge Analytica, за да стане ясно защо това действително е една най-сериозните заплахи за демократичните процеси в ЕС и в частност за интегритета на проведените през май избори.

Дефинирана като „доказуемо невярна или подвеждаща информация, която се създава, представя и разпространява с цел да се извлече икономическа изгода или съзнателно да бъде подведена обществеността, като последиците от това могат да бъдат в ущърб на обществения интерес“, дезинформацията се привежда в действие по много и най-различни начини. Превземането на акаунти в социалните медии, мащабното внедряване на ботове, „фермите“ за фалшиви новини, микропрофилирането в разпространението на съобщения, касаещи партии или отделни кандидати, чрез незаконна употреба на лични данни, са само част от тях.

Дезинформация се разпространява и чрез традиционните медии, но социалните мрежи са средата с най-ниска защита,

най-слаби правила, както и с предпоставки за усилване на ефекта на информационния безпорядък поради „дефекти в дизайна“ и възприетия бизнес модел. По тази причина ограничаването на дезинформацията неминуемо минава през сътрудничеството с Google, Facebook и Twitter. Трите технологични гиганта едновременно станаха страни по Кодекса за добри практики от септември 2018 г., чрез който се ангажираха с проблема, и в периода януари–май 2019 г. всеки месец докладваха на ЕК за напредъка по предприетите мерки.

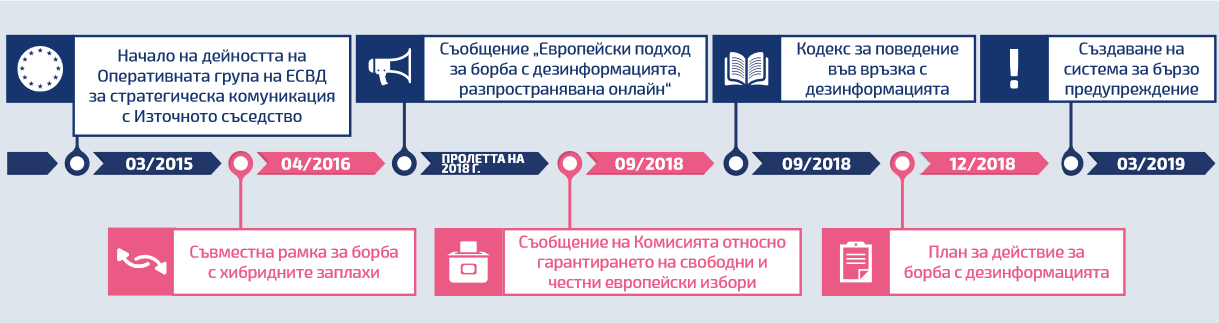

Този кодекс обаче е само един от компонентите на комплексната рамка за справяне с проблема, разработена от Европейската комисия и върховния представител на Съюза в плана за действие срещу дезинформацията. Дезинформацията стана обект на засилени координирани мерки от страна на европейските институции и държавите членки през 12-те месеца преди изборите за ЕП, но ЕС припознава и адресира опасността от онлайн дезинформационни кампании, и по-конкретно тези, провеждани от Русия, още през 2015 г., когато е сформирана Оперативната група на ЕС за стратегическа комуникация с Източното съседство (East StratCom Task Force).

Година по-късно е създадена и съвместна (на ЕК и върховния представител) рамка за борба с хибридните заплахи и за укрепване на устойчивостта на ЕС, неговите държави членки и партньорските страни, както и за активизиране на сътрудничеството с НАТО за противодействие на тези заплахи. Оперативната група обаче получава специални ресурси едва през 2018 г., когато ѝ е отпуснат бюджет от 1,1 млн. евро за противодействие на руската дезинформация. (През 2019 г. бюджетът ѝ е утроен и насочен към осигуряването на професионален медиен мониторинг, анализ на дезинформацията и на данните с цел получаване на по-цялостна и по-точна картина на руските кампании.)

Както се вижда и от горната инфографика, най-много действия, съсредоточени върху проблема за дезинформацията онлайн, бяха предприети през 2018 г. и достигнаха своята кулминация в самия ѝ край с обявения план за действие срещу дезинформацията. През юни 2019 г. ЕК публикува доклад във връзка с изпълнението на плана и ефективността на допълващия го пакет мерки за провеждане на свободни и честни избори за Европейски парламент. Въпреки че не са категорични и еднозначни, първоначалните изводи от доклада са, че предприетите мерки, включващи системни усилия за повишаване на осведомеността на журналисти, проверители на факти, платформи, национални органи, научни работници и членове на гражданското общество, са изиграли положителна роля.

В доклада се посочва, че макар да не е установена отделна трансгранична кампания за дезинформация от външни източници,

събраните доказателства свидетелстват за непрекъсната дезинформационна дейност от руски източници,

целяща популяризиране на крайни възгледи, поляризиране на дебатите на местно равнище, потискане на избирателната активност и повлияване върху предпочитанията на гласоподавателите.

Тя е била свързана с най-различни теми — от поставянето под въпрос на демократичната легитимност на Съюза до стимулирането на разединяващи обществени дебати по въпроси като миграцията и суверенитета. Злонамерени лица са използвали пожара в катедралата „Нотр Дам“ като илюстрация на предполагаемия залез на западните и християнските ценности в ЕС, а правителствената криза в Австрия е приписвана на „европейската държава в сянка“, на „германските и испанските служби за сигурност“ и на други лица, казва се още в доклада.

Анализаторите са установили, че вместо да провеждат широкомащабни операции, дезинформационните агенти се насочват към операции на местно равнище, които са по-трудни за откриване и разобличаване. Според FactCheckEU в периода преди европейските избори е имало по-малко дезинформация от очакваното и тя не е преобладавала в обсъжданията, какъвто бе случаят при последните избори в Бразилия, Обединеното кралство и САЩ.

Въпреки това в доклади от изследователи, проверители на факти и гражданското общество са били идентифицирани

редица примери за широкомащабни опити за манипулиране на поведението на избирателите в поне девет държави членки.

Така например за над 600 Facebook групи и страници във Франция, Германия, Италия, Обединеното кралство, Полша и Испания е съобщено, че разпространяват дезинформация и реч на омразата или че са използвали фалшиви профили, за да повишат изкуствено видимостта на съдържанието на партии или сайтове, които подкрепят.

Трудностите, свързани с достъпа на независими изследователи до данни от платформите, се изтъкват като едно от основните препятствия пред точното оценяване на обхвата и въздействието на кампаниите за дезинформация. В тази връзка ЕК призовава платформите да си сътрудничат с проверителите на факти във всички държави членки, да се погрижат потребителите да могат по-добре да откриват дезинформация и да предоставят реален достъп до данни на изследователската общност.

Както вече стана дума по-горе, през първите пет месеца от 2019 г. ЕК изиска отчетност и съвместно с Групата на европейските регулатори за аудио-визуални медийни услуги анализира действията, предприети от Facebook, Google и Twitter въз основа на месечните доклади, предоставени от тези платформи. Налице е подобряване на прозрачността и контрола върху рекламното позициониране с цел ограничаване на злонамерените практики от типа „кликбейт“ и намаляване на приходите от реклами на лицата, публикуващи дезинформация, осуетено е манипулативното поведение, целящо повишаване на видимостта на съдържанието чрез координирани операции, както и злоупотребите с ботове и фалшиви профили.

Дезактивирани са 3,39 млн. YouTube канала и 2,19 млрд. фалшиви Facebook профила

Google докладва, че е премахнал над 3,39 млн. YouTube канала заради нарушения на неговите политики за спам и използването на чужда самоличност. Facebook е дезактивирал 2,19 млрд. фалшиви профила само през първото тримесечие на 2019 г. и е предприел специфични действия срещу над 1700 (едва 168 от които базирани в ЕС) страници, групи и профили с неавтентично поведение, насочено към държавите от ЕС. Фалшивите и разпространяващи спам профили, засечени от Twitter, са 77 млн. (в световен мащаб).

Това е равносметката от партньорството между ЕС и най-големите онлайн платформи, които заедно със софтуерни компании и органи, представляващи рекламната индустрия, приеха кодекс за поведение във връзка с дезинформацията. Неговата ефективност ще бъде оценена от ЕК наесен, 12 месеца след началото на изпълнението, а ако резултатите от оценката са незадоволителни, Комисията ще преразгледа саморегулаторния подход и би могла да предложи решения от регулаторен характер.

Специален акцент в доклада е поставен върху системата за ранно предупреждение,

внедрена най-късно от всички изброени по-горе мерки (вж. инфографиката). Създадена с по-дългосрочна цел от тази да допринесе за координацията между държавите членки в навечерието на изборите, когато се очакват „масирани дезинформационни кампании“, тя заработи само месец преди провеждането им. Тогава еврокомисарят по цифровото общество Мария Габриел разясни, че ЕК е решила да даде „свободата на всяка държава членка сама да избере националната си контактна точка в зависимост от това къде тя прецени, че е звеното, което би било най-адекватно за реакция“. Също така едва тогава бе потвърдено, че в България за въпросната контактна точка отговаря вицепремиерът Томислав Дончев.

Въпреки това в доклада на ЕК се изтъква, че системата за бързо предупреждение е доказала своята ефективност и се е превърнала в ключово средство за борба с дезинформацията, поради което и е планирано засилване на сътрудничеството в нейните рамки, включително чрез разработване на обща методология за анализ и изобличаване на кампаниите за дезинформация и по-силни партньорства с международни партньори като Г-7 и НАТО.

Противодействието на хибридните заплахи и киберсигурността са сред областите на сътрудничество между ЕС и НАТО,

а през юни 2018 г. в Шарлевоа, Канада, държавите от Г-7 приеха декларация за защита на демокрацията от чуждестранни заплахи, набелязвайки сходни на предприетите от Европейския съюз мерки, с които да се гарантират „свободата, независимостта и плурализмът на медиите, базираната на факти информация и свободата на изразяване“.

При толкова много планове, пътни карти, стратегии, кодекси, споразумения за сътрудничество и прочее е очевидно, че правовите държави, и в частност тези от ЕС, търсят решение на проблема с дезинформацията онлайн. Доколко работещо е това решение обаче, е много трудно да се изчисли, въпреки че щетите от дезинформацията почти винаги са и материални. Още по-трудно е да се изчисли

до каква степен потърпевша от мерките е свободата на изразяване.

Инструменти като Google Analytics и Facebook Insights измерват почти всичко друго, но не и това…

Добавено на 8 юли 2019 г.:

Доколко системата за ранно предупреждение действително е ефикасна (с уговорката, че тя заработи едва през април), е спорно, като се имат предвид многото неясноти, свързани с експлоатацията ѝ. Става дума за тънката граница между „дезинформация“ и „пропаганда“ например, както и за субективните интерпретации и преценки на толкова много играчи, върху които влияние оказва и специфичният политически климат в съответната държава.

В деня на публикуване на този материал „Ню Йорк Таймс“ излезе със статия, в която представя гледните точки на „повече от дузина настоящи и бивши европейски служители“. Според тях системата е по-скоро безполезна; цитиран е и конкретен пример за неподаден сигнал от страна на австрийските служби, свързан с циркулацията на подвеждащо съдържание в Twitter. Повечето държави членки не са допринесли по какъвто и да било начин, а голяма част от подадената информация не е била анализирана, твърди се в статията, позоваваща се на интервюта и вътрешни документи. По тази причина дори служители, които подкрепят внедряването на системата, имат резерви относно бъдещето ѝ, в случай че не бъдат направени необходимите промени. А мнозина изобщо не възприемат сериозно т.нар. система за ранно предупреждение.

„Тоест“ се издържа от читателски дарения

Ако харесвате нашата работа и искате да продължим, включете се с месечно дарение.

Подкрепете ни